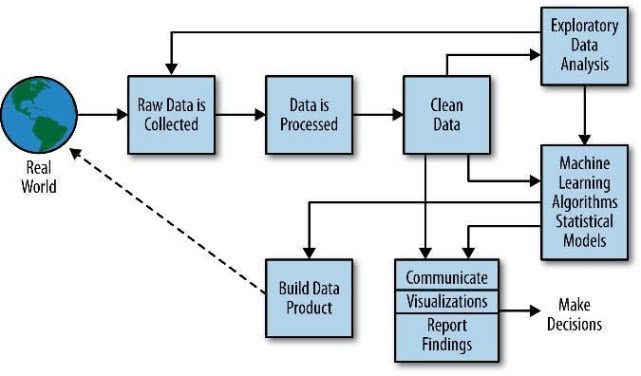

大数据技术作为信息时代的重要支柱,已成为各行各业数字化转型的核心驱动力。其中,数据处理技术是大数据知识体系中的关键环节,掌握好数据处理技术是成为大数据专业人才的必经之路。本文将围绕大数据处理技术,系统介绍其知识体系和学习路径,为学习者提供清晰的方向。

一、大数据处理技术知识体系

1. 数据采集与集成

数据采集是大数据处理的第一步,涉及从多种数据源获取数据的技术。主要包括:

- 日志采集工具(如Flume、Logstash)

- 网络爬虫技术

- 消息队列(如Kafka、RabbitMQ)

- 数据同步工具(如Sqoop、DataX)

2. 数据存储与管理

大数据存储技术需要解决海量数据的持久化问题:

- 分布式文件系统(HDFS)

- NoSQL数据库(HBase、Cassandra、MongoDB)

- 数据仓库(Hive、ClickHouse)

- 新型存储引擎(如Lakehouse架构)

3. 数据计算与处理

这是大数据处理的核心环节,包括:

- 批处理技术:MapReduce、Spark Core

- 流处理技术:Spark Streaming、Flink、Storm

- 图计算:GraphX、Giraph

- 内存计算:Spark

4. 数据查询与分析

提供数据访问和分析能力:

- SQL-on-Hadoop技术(Hive、Impala)

- 交互式查询引擎(Presto、Druid)

- OLAP分析工具

5. 数据治理与质量

确保数据的可靠性和可用性:

- 元数据管理

- 数据血缘分析

- 数据质量监控

- 数据安全与隐私保护

二、大数据处理技术学习建议

- 基础阶段(1-3个月)

- 掌握Linux操作系统基础命令

- 学习Java或Scala编程语言

- 理解分布式系统基本原理

- 熟悉SQL语言和数据库概念

- 核心框架学习(3-6个月)

- Hadoop生态圈:重点掌握HDFS、MapReduce、YARN

- Spark核心技术:RDD、DataFrame、Spark SQL

- 消息队列:Kafka原理与应用

- 数据仓库:Hive的使用和优化

- 进阶实践(6个月以上)

- 搭建伪分布式或完全分布式集群

- 参与实际数据处理项目

- 学习性能调优和故障排查

- 关注新兴技术如Flink、Iceberg等

- 持续学习建议

- 关注开源社区动态和技术演进

- 阅读官方文档和源码

- 参与技术社区讨论

- 考取相关认证(如Cloudera、Hortonworks认证)

三、实践项目推荐

- 日志分析系统:使用Flume采集日志,Kafka作为消息队列,Spark Streaming进行实时处理

- 用户行为分析:基于Hive构建数据仓库,进行用户画像和推荐分析

- 电商数据处理:构建完整的ETL流程,实现销售数据的多维度分析

学习大数据处理技术需要循序渐进,从基础理论到框架使用,再到项目实践。建议学习者在掌握单个组件后,尝试将它们组合成完整的数据处理流水线,这样才能真正理解大数据处理的完整流程。同时,保持对新技术的敏感度,不断更新知识体系,方能在快速演进的大数据领域保持竞争力。